Notice

Perception multimodale et interaction sociable

- document 1 document 2 document 3

- niveau 1 niveau 2 niveau 3

Descriptif

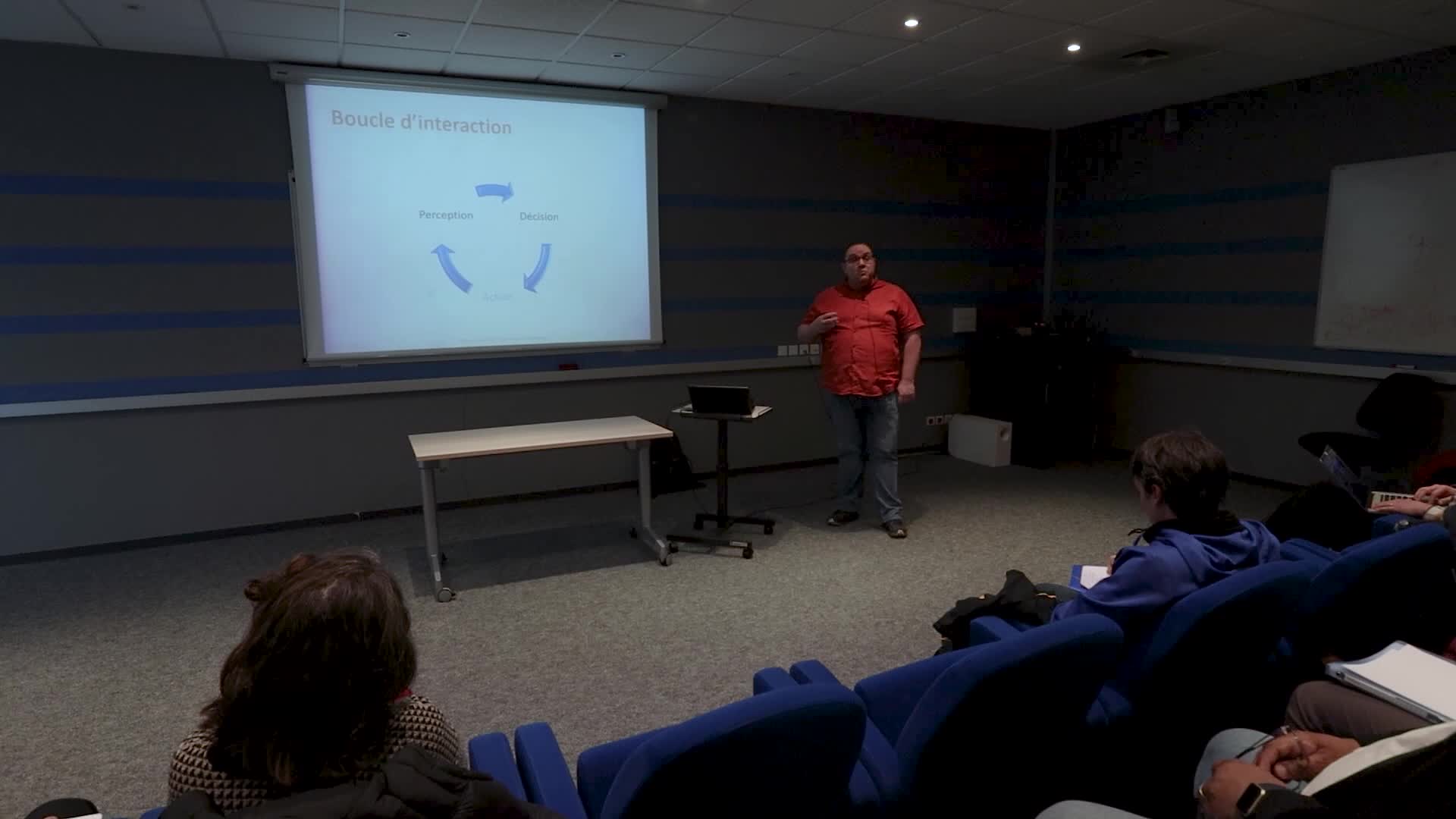

Au cours des deux dernières décennies, de très nombreux progrèsont été faits dans le domaine de la perception par ordinateur, c’est-à-dire desalgorithmes permettant à ce dernier de percevoir, comme le ferait un humain,son environnement. Cette perception a tout d’abord été monomodale (visuelle ousonore par exemple) et est devenue fortement multimodale au fil du tempspermettant de nombreuses avancées, notamment grâce à l’avènement récent del’apprentissage profond (Deep Learning ).

Cette présentation s’attachera à dépeindre la perception multimodale aucours de ces deux décennies sous le prisme des travaux de recherche menés dansles équipes PRIMA et Pervasive Interaction d'Inria. Nous aborderons égalementles applications en interaction sociable homme/machine permises par cetteperception (espaces perceptifs multimodaux, robots compagnons, véhiculesautonomes)

Avec les mêmes intervenants et intervenantes

-

Perception multimodale et interaction sociable

VaufreydazDominiqueAu cours des deux dernières décennies, de très nombreux progrès ont été faits dans le domaine de la perception par ordinateur, c’est-à-dire des algorithmes permettant à ce dernier de percevoir,

-

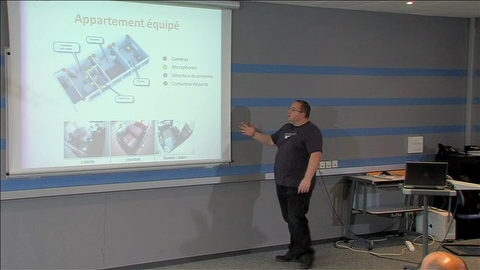

Reconnaissance d'activités en environnement "intelligent"

VaufreydazDominiqueDans cet exposé, nous nous intéressons à la notion de perception en environnement dits "intelligents" au sens large du terme.

Sur le même thème

-

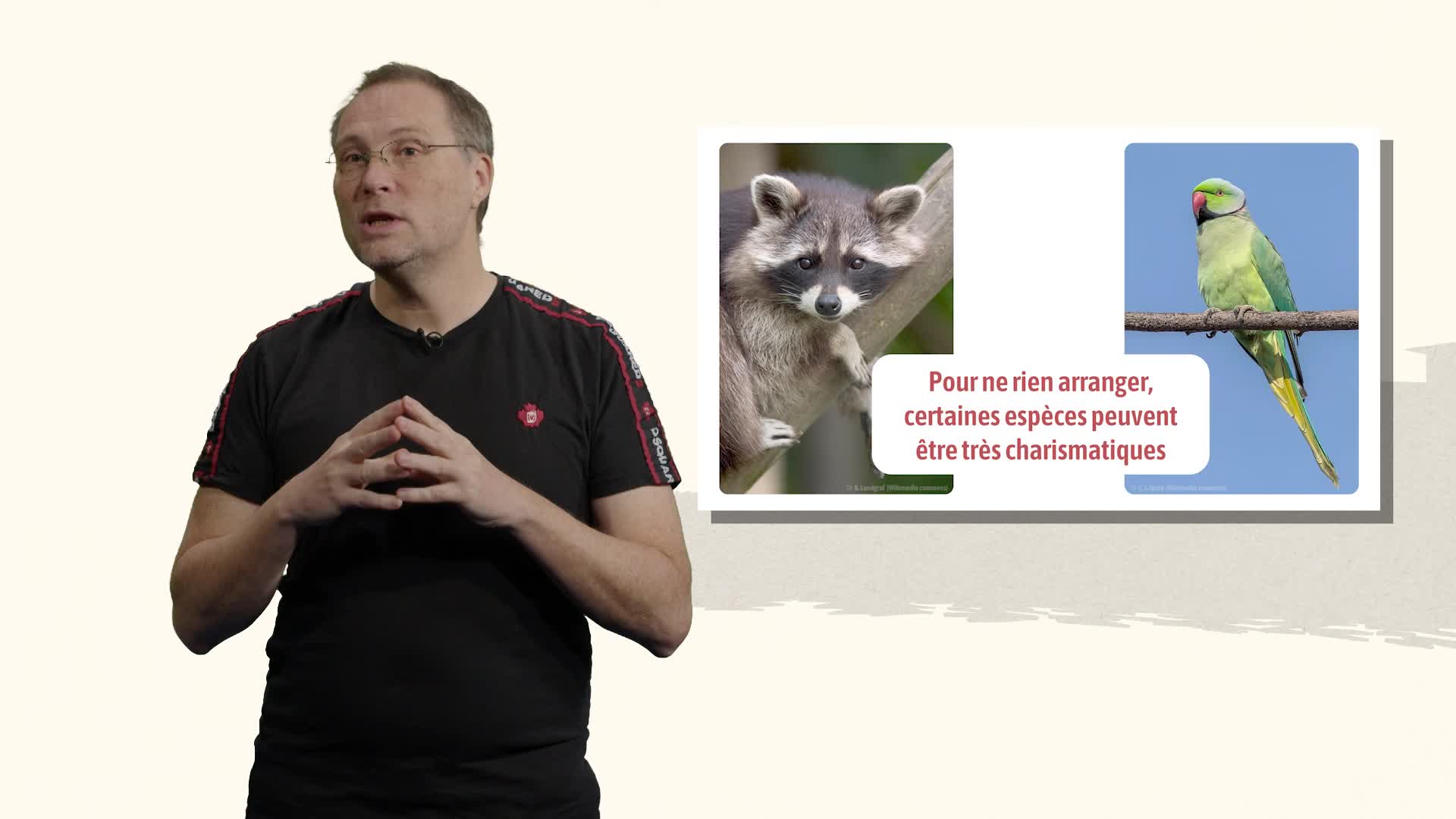

Invasions biologiques : de la prise de conscience à l'action collective

CourchampFranckFranck Courchamp, directeur de recherche au CNRS, explique dans cette vidéo les raisons du paradoxe entre la gravité du problème des invasions biologiques et sa perception politique et sociale encore

-

Les invasions biologiques : quelles perceptions par le public ?

ArbieuHugoUgo Arbieu, chercheur post-doctorant à l'université Paris Saclay, montre dans cette vidéo l'intérêt de la culturomique pour étudier la perception sociale des invasions biologiques.

-

Vent et ville : atelier

GoffetteCharlotteCharlotte Goffette propose aux participants un atelier pour tester in situ ses petits instruments de mesure sensible du vent.

-

Vent et ville

GoffetteCharlotteCharlotte Goffette, chercheuse en design, anime une matinée consacrée à son travail sur le vent.

-

Science et opinion dans les Seconds analytiques d'Aristote

MorelPierre-Marie[ Science et opinion dans les Seconds analytiques d'Aristote ]

-

Table ronde 3 : Du terrain à l’image

ForlenMissiaGomezLaureenSetenSevilBrayerLaureTixierNicolasBeaucampBenjaminComment les images (photographiques, filmiques, cartographiques, graphiques, etc.) sont-elles porteuses de compréhensions singulières des territoires et ambiances investigués ?

-

Mur haptique : expériences autour du matériau terre

Miranda SantosMartaAlvarez CollNuriaOuvrardPaulineCette présentation questionne les spécificités des ambiances conçues et construites en terre crue, à travers d’une expérience sensorielle qui interroge la perception des usagers d’un espace avant et

-

Session 2 : Ambiances lumineuses : perceptions /conceptions

DrozdCélineChelkoffGrégoireRequena-RuizIgnacioDans un contexte de forte mobilisation autour des économies d’énergie, la gestion réfléchie des flux lumineux a un rôle à jouer dans les projets d’architecture. Par ailleurs, la lumière naturelle

-

Session 1 : Qualifier les sensibilités écologiques : démarches participatives

L’HerGwendolineLuneauAymericPoupinPerrineManolaThéaAymeric Luneau et Gwendoline l'Her vont nous parler des sensibilités écologiques, des difficultés à les qualifier, et de la manière dont elles s'agencent dans les démarches de recherches

-

Un dictionnaire pour présenter 50 ans de recherche en ergonomie (ASR N°22 - PERSEUS)

BrangierÉricValléryGérardPour beaucoup, l'ergonomie se limite à la conception et à l'usage d'un outil ou d'un produit. Mais cette discipline encore méconnue englobe bien d'autres aspects du monde du travail et de la vie

-

Entre les mots et les choses : intervention de Claire Petitmengin

PetitmenginClaireIntervention de Claire Petitmengin qui porte sur la dimension ressentie de l'expérience vécue, une part non remarquée de l'expérience, qui semble échapper à notre conscience.

-

Les franges du phénoménal : introduction au séminaire 2

ThibaudJean-PaulHigginMarcLabussièreOlivierIntroduction au séminaire 2 du projet ANR Sensibilia.

![Conférence de Pierre-Marie Morel [ Science et opinion dans les Seconds analytiques d'Aristote ]](https://vod.canal-u.tv/videos/2024/03/96807/040324-morel-diff.jpg)